TranslatorBot

Description

TranslatorBot a pour but de traduire les pages en plusieurs langues au moyen de la librairie Python: googletrans qui exploite les services de traduction de Google.

Méthode de traduction

On traduit par bloc d'environ 5000 caractères, en adaptant la taille du bloc selon la ponctuation (afin d'être certain de traduire une phrase complète et non une partie de la phrase).

Afin d'avoir une meilleure synergie avec d'autres bots, TranslatorBot prendra en paramètre la liste des pages à traduire ainsi que la langue choisie. Cela permet de garder le contrôle du bot et d'éviter qu'il traduise à la chaîne chaque nouvelle page qu'il trouve.

TranslatorBot est entièrement modulable grâce à un système de vérification du vocabulaire distinguant les noms propres des noms communs.

TranslatorBot crée la page traduite dans un répertoire correspondant à la langue choisie.

Problèmes rencontrés

- Un des premiers problèmes considérés, au vu des pages déjà existantes sur wikipast, a été la traduction des pages générées ou modifiées par des bots. Celles-ci étant parfois victimes d'actions indésirables d'autres bots, leur contenu n'a aucun sens et, par conséquent, devient impossible à traduire.

→ Le problème s'est réglé de lui-même: la méthode appelée par TranslatorBot garde la partie problématique du texte non modifiée. Il s'agit d'un soucis à considérer par le ManagerBot.

- Si on ne traduit pas les hyperlinks, comment faire la différence entre un hyperlink d'un nom propre qui va vers une page en français et celui qui mène en anglais?

→ Ce problème est réglé avec la solution pour les noms propres par biais d'un nouveau bot qui classe les pages des personnalités.

- Un autre problème important consiste en traduction des noms propres. A première vue, les noms propres tels que les noms géographiques doivent être traduits; cependant, les noms des personnes ne sont pas à traduire. Un autre problème se pose ici: comment distinguer un nom de famille d'origine géographique d'un nom géographique?

→ La solution la plus élégante serait de laisser à la prochaine volée d'étudiants la création d'un nouveau bot qui classerait les pages existantes selon leur genre. Ceci permettrait de facilement distinguer les pages de personnalités des autres.

- Une question pertinente est la séparation des blocs à traduire.

→ On boucle sur le texte: on part du 5000-ème caractère et on itère sur les caractères précédents pour trouver l'indice d'une ponctuation de fin de phrases. On traduit le bloc de texte jusqu'à cet indice, et puis on réitère l'opération.

- Comment gérer les pages traduites: répertoire selon les langues

→ (en cours de solution)

- La mise en page est-elle conservée par le bot ?

→ (en cours de solution)

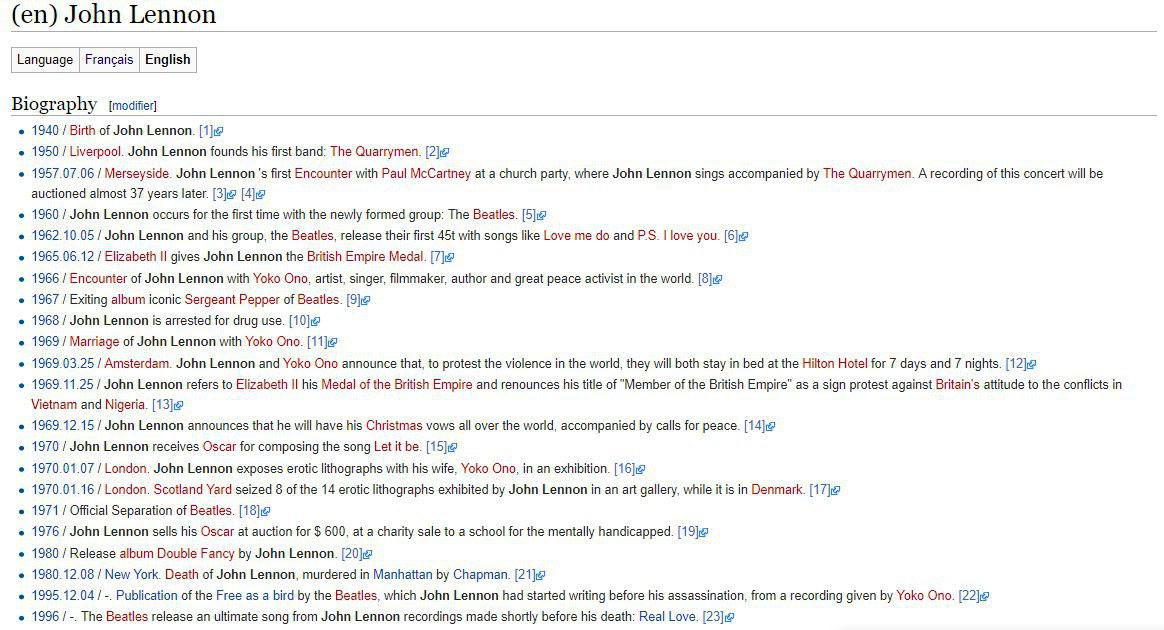

Exemples de Résultats

Original français:

→ https://i.imgur.com/skur1p1.jpg

Résultat de traduction par TranslatorBot:

→ https://i.imgur.com/0gPBvEp.jpg

Évaluation du Bot

Temps de traduction: (à compléter une fois l'implémentation du bot est terminée)

Qualité de traduction: (à compléter une fois l'implémentation du bot est terminée)

Programmation

Le bot a été créé au cours d'un travail de groupe. Le code a été partagé via une repository privée sur GitHub. L'environnement utilisé est Anaconda et Jupiter Notebook.

L'implémentation du bot a été précédée par des recherches sur la création des bots.

Code

import requests

from bs4 import BeautifulSoup

from googletrans import Translator

user='testbot'

passw='dhbot2017'

baseurl='http://wikipast.epfl.ch/wikipast/'

summary='Wikipastbot update'

names=['Henri Dunant']

translator = Translator()

# login request

payload={'action':'query','format':'json','utf8':'','meta':'tokens','type':'login'}

r1=requests.post(baseurl + 'api.php', data=payload)

# login confirm

login_token=r1.json()['query']['tokens']['logintoken']

payload={'action':'login','format':'json','utf8':'','lgname':user,'lgpassword':passw,'lgtoken':login_token}

r2=requests.post(baseurl + 'api.php', data=payload, cookies=r1.cookies)

# get edit token2

params3='?format=json&action=query&meta=tokens&continue='

r3=requests.get(baseurl + 'api.php' + params3, cookies=r2.cookies)

edit_token=r3.json()['query']['tokens']['csrftoken']

edit_cookie=r2.cookies.copy()

edit_cookie.update(r3.cookies)

# we fetch the text we want to translate

for name in names:

result=requests.post(baseurl+'api.php?action=query&titles='+name+'&export&exportnowrap')

soup=BeautifulSoup(result.text, "lxml")

code=''

for primitive in soup.findAll("text"):

code += primitive.string

translated_text = translator.translate(code[:5000], src='fr', dest='en').text

#Create names with english prefix

en_name = 'en/' + translator.translate(name, src='fr', dest='en').text

Conclusion et Remerciements

Nous remercions le cours SHS Humanités Digitales pour cette magnifique opportunité de nous organiser pour travailler sur un projet nouveau et