Triplificator

Génère un document RDF à partir du contenu d'une page biographique de Wikipast.

Description

Le Triplificator est un bot qui va se charger d'exprimer l'information contenue dans les datafications biographiques de Wikipast à l'aide de la structure RDF (Resource Description Framework). Celle-ci permet d'organiser l'information non structurée des pages Wikipast en la rendant interprétable par la majorité des applications. Cette conversion a donc pour but d'augmenter la portée des datafications biographiques en permettant le traitement automatique de leur contenu par des applications externes.

Une page Wikipast structurée en RDF est composée de triplets RDF. En effet, l'information contenu dans une entrée est résumée à l'aide de l'association de 3 mots, le Sujet, le Prédicat et l'Objet, qui établit le lien existant entre les éléments contenus dans l'information non structurée. Enfin, le Triplificator va mettre le contenu RDF sur une nouvelle page texte à laquelle on peut accéder depuis un lien mis à la fin de la biographie sur la page Wikipast.

Fonctionnalités

- Lecture de la page Wiki

- Le contenu de la page Wikipast est extrait (Web scraping) afin de récupérer les hypermots tels que la date, le lieu et les différentes actions dans chaque entrée de la datafication, que le bot va ensuite classer afin d'y accéder facilement et de les utiliser pour créer les triplets RDF.

- Interprétation du contenu et mise en forme sous format RDF

- Pour interpréter l'information reçue et la convertir en triplets RDF, nous avons créé une librairie d'évènements tels que "Naissance" ou "Mort" qui sont référencés par rapport au moteur de définitions Vocab.org. A partir de cette librairie, le Triplificator va associer une action venant de la datafication biographique avec son équivalent dans la librairie référencée et va ensuite nous donner un triplet sur l'action en question, qui est donc le prédicat du triplet, le sujet étant toujours le nom du personnage de la biographie et l'objet pouvant varier selon la cible du prédicat. Il est important de noter que l'on suppose que la syntaxe des biographies ait été respectée afin d'assurer le bon fonctionnement du Triplificator.

- Mise en ligne de la nouvelle page

Problèmes rencontrés et éventuelles améliorations

- Librairie de prédicats

- Un des problèmes majeurs lié à la conversion en format RDF est la retransmission des prédicats. En effet, la liste des mots que nous avons référencés étant créée en interne, nous possédons un nombre limité de ces mots. Ceci donne lieu à un fichier RDF qui ne contient pas la totalité des entrées de chaque datafication biographique car le bot n'y reconnaît simplement pas tous les prédicats. Il est également important de noter que notre liste a été créée à partir d'une seule source de référence (Vocab.org). Une amélioration possible de notre bot serait donc d'utiliser soit plusieurs sources, soit une plus grande librairie de références, ou encore de faire en sorte que le bot puisse accéder directement à la(aux) source(s) et qu'il construise en amont et par lui-même un dictionnaire de prédicats référencés.

- Syntaxe Wikipast

- Comme mentionné dans une section précédente, nous avons supposé la que la syntaxe Wiki ait été parfaitement respectée, à savoir "DATE / LIEU. ACTION PERSONNAGE OBJET", afin que le Triplificator puisse agir correctement sur la page d'une biographie. Bien que nous ayons légèrement amélioré le bon fonctionnement du bot pour une mauvaise syntaxe, par exemple en précisant que le lieu n'a pas été indiqué dans une ligne mais que le bot continue de la lire correctement pour en extraire les bonnes informations, nous nous concentrons sur la conversion RDF en elle-même et nous comptons sur le travail d'un autre bot qui pourrait éventuellement corriger la syntaxe d'une page biographique, où notre bot pourrait alors effectuer son travail de "triplification".

- Format XML

- Afin que le document RDF puisse être lisible facilement par n'importe quelle plateforme, l'idéal aurait été de convertir en format XML (Extensible Markup Language) qui est le format de référence, tout d'abord pour transporter de l'information en général, mais plus précisément celui utilisé pour écrire un fichier RDF la majorité du temps. La conversion en un tel format étant un travail à part entière et différent de notre objectif principal, nous avons également choisi de la laisser en éventuelle amélioration qui est réalisable dans le futur.

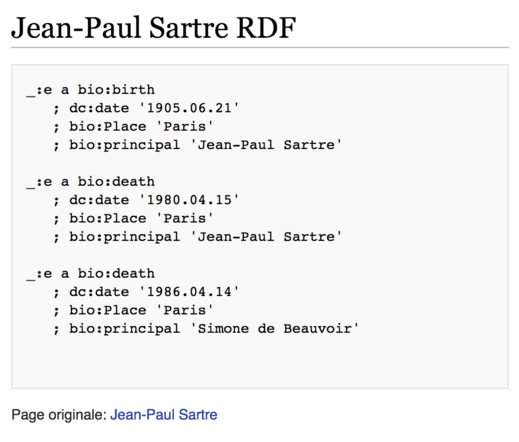

Exemple de résultat

Exemple de résultat après avoir fait tourner le bot sur la page Wikipast de Jean-Paul Sartre.

Code

# -*- coding: utf-8 -*-

import requests

from bs4 import BeautifulSoup

# Création de la base de données

Wikipast = ["Naissance", "Décès", "Retraite", "Élection", "Obsèques", "Participation", "Mort", "Démission",

"Nomination", "Diplôme", "Organisation", "Naturalisation", "Invention", "Rôle", "Meurtre",

"Inauguration", "Rencontre", "Mariage"]

VocabORG = ["birth", "death", "retirement", "investiture", "funeral", "participant", "death", "resignation",

"investiture", "graduation", "organization", "naturalization", "creator", "role", "murder",

"inauguration", "has met", "marriage"]

LibORG = ["bio", "bio", "bio", "bio", "bio", "bio", "bio","bio","bio","bio","bio","bio", "frbr/core",

"participation","bio","bio","relationship", "bio"]

Types = [["bio:principal"], ["bio:principal"], ["bio:principal"], ["bio:principal"], ["bio:principal"],

["bio:principal"], ["bio:principal"], [], ["bio:principal", "bio:organization"],

["bio:principal", "bio:organization"], ["bio:principal", "bio:organization"], [],

["bio:event", "bio:principal"], ["bio:principal", "bio:nationality"], ["bio:work", "bio:principal"],

["bio:principal", "frbr/core:work"], ["bio:principal", "bio:participant"], ["bio:organization"],

["bio:principal"], [], ["bio:principal"], ["bio:partner"], ["bio:principal", "bio:partner"]]

# Construction d'un dictionnaire contenant les données

BDD = {}

for terme in Wikipast:

indice = Wikipast.index(terme)

BDD[terme] = (VocabORG[indice], LibORG[indice], Types[indice])

# Extraction des noms

noms = []

baseurl = 'http://wikipast.epfl.ch/wikipast/'

resultat = requests.post(baseurl+'api.php?action=query&titles='+'Biographies'+'&export&exportnowrap')

soup = BeautifulSoup(resultat.text, "lxml")

code_noms=''

for primitive in soup.findAll("text"):

code_noms += primitive.string

for phrase in code_noms.split("| [["):

nom = phrase.split("]]")

nom = nom[0].strip()

nom = nom.replace(' ','_')

noms.append(nom)

noms = noms [1:]

# Traitement de chaque datafication biographique par le bot

for nom in noms:

sortie = ""

code = ''

result = requests.post(baseurl + 'api.php?action=query&titles=' + nom + '&export&exportnowrap')

soup = BeautifulSoup(result.text, "lxml")

for primitive in soup.findAll("text"):

code += primitive.string

entrees = code.split("*")

entrees_avec_resultat = 0

for entree in entrees:

lieu = []

date = []

#Trouve la date

date_lieu_action = entree.split("/")

date = date_lieu_action[0]

date = date.replace("[[", "")

date = date.replace("]]", "")

date = ''.join(date.split()) # supprimer tout les whitspaces (tab, retours à la ligne, espace...)

if not(date) or not date[0].isdigit(): #Si le premier élément n'est pas un nombre, ce n'est probablement pas une date

continue

#Trouve le lieu

if len(date_lieu_action) > 1: #s'il y a plus qu'une date

lieu_action = date_lieu_action[1]

lieu_action = lieu_action[:-6]

lieu_action = lieu_action.strip()

points = lieu_action.count('.')

if lieu_action.endswith('.'):

if points > 1:

lieu_action = lieu_action.split('.')

lieu = lieu_action[0]

lieu = lieu.replace("[[", "")

lieu = lieu.replace("]]", "")

lieu = ''.join(lieu.split()) #supprimer tout les whitspaces (tab, retours à la ligne, espace...)

else:

lieu = '-'

lieu_action = [lieu] + [lieu_action]

else:

if points !=0:

lieu_action = lieu_action.split('.')

lieu = lieu_action[0]

lieu = lieu.replace("[[", "")

lieu = lieu.replace("]]", "")

lieu = ''.join(lieu.split()) # supprimer tout les whitspaces (tab, retours à la ligne, espace...)

else:

lieu = '-'

lieu_action = [lieu] + [lieu_action]

if len(lieu_action) < 2:

continue

split_phase_1 = lieu_action[1].split("[[")

actions = []

for mot in split_phase_1:

action = mot.split("]]")

actions.append(action[0].strip())

if "" in actions:

actions.remove("")

if len(actions) != 0:

for hypermot in BDD:

if hypermot == actions[0]:

entrees_avec_resultat += 1

sortie = sortie + "_:e a " + BDD[hypermot][1] + ":" + BDD[hypermot][0] + "\n ; dc:date '" + date + "'\n ; bio:Place '" + lieu + "'\n"

for type in BDD[hypermot][2]:

indice = BDD[hypermot][2].index(type) + 1

try: actions[indice]

except: continue

sortie = sortie + " ; " + type + " '" + actions[indice] + "' \n"

sortie += "\n"

# Création de la page RDF correspondante

if entrees_avec_resultat > 1:

nouveau_nom = nom.replace('_',' ') + " RDF"

user='Triplificator'

passw='RDF2018'

summary='Triplificator update'

payload={'action':'query','format':'json','utf8':'','meta':'tokens','type':'login'}

r1=requests.post(baseurl + 'api.php', data=payload)

login_token=r1.json()['query']['tokens']['logintoken']

payload={'action':'login','format':'json','utf8':'','lgname':user,'lgpassword':passw,'lgtoken':login_token}

r2=requests.post(baseurl + 'api.php', data=payload, cookies=r1.cookies)

params3='?format=json&action=query&meta=tokens&continue='

r3=requests.get(baseurl + 'api.php' + params3, cookies=r2.cookies)

edit_token=r3.json()['query']['tokens']['csrftoken']

edit_cookie=r2.cookies.copy()

edit_cookie.update(r3.cookies)

content= ''

content+=' <nowiki>\n'

content+= sortie

content+='\n'

content+='Page originale: '+nom.replace('_',' ')+'\n'

payload={'action':'edit','assert':'user','format':'json','utf8':,'text':content,'summary':summary,'title':nouveau_nom,'token':edit_token}

to_replace = 'Version RDF : '+nouveau_nom+'' code = code.replace(to_replace,' ')

payload2 = {'action': 'edit', 'assert': 'user', 'format': 'json', 'utf8': , 'text': code + '\n' + 'Version RDF : '+nouveau_nom+'', 'summary': summary, 'title': nom, 'token': edit_token}

r4 = requests.post(baseurl + 'api.php', data=payload, cookies=edit_cookie)

r4=requests.post(baseurl+'api.php',data=payload2,cookies=edit_cookie)</nowiki>